Tiempo de lectura: 10 minutos

TL;DR

El vibe coding (dejar que la IA genere aplicaciones completas a partir de instrucciones en lenguaje natural) ha crecido de forma explosiva. Para quien no programa, es una revolución: de repente cualquiera puede crear software. Pero la conversación suele quedarse ahí, como si el vibe coding fuera solo para gente que no sabe escribir código.

Eso es quedarse corto. El vibe coding es mucho más potente en manos de desarrolladores profesionales. La diferencia está en qué haces con el tiempo que te libera. Un no-programador acepta lo que la IA produce. Un desarrollador profesional utiliza la IA para encargarse de las partes tediosas mientras se centra en lo que de verdad importa: arquitectura, seguridad, decisiones tecnológicas y control de calidad.

A esto lo llamo Professional Vibe Coding, y es el futuro de cómo los ingenieros con experiencia van a construir software.

¿Qué es el Vibe Coding?

El término lo acuñó Andrej Karpathy: escribir software describiendo lo que quieres en lenguaje natural y que la IA se encargue de la implementación. Herramientas como Cursor, Windsurf, Claude Code, GitHub Copilot, v0, Bolt y Lovable lo han puesto al alcance de cualquiera.

El flujo de trabajo típico:

- Describes lo que quieres en lenguaje natural

- La IA genera el código

- Lo ejecutas

- Si falla, pegas el error y dejas que la IA lo arregle

- Repites hasta que funcione

Para alguien que nunca ha escrito una línea de código, esto es magia. Pasar de idea a prototipo funcional en minutos. Sin aprender React, sin entender esquemas de bases de datos, sin configurar pipelines de build. Solo vibrar.

Para prototipos, proyectos personales y herramientas internas rápidas, funciona. El vibe coding ha democratizado la creación de software, y eso es positivo. Pero tiene un problema.

La Brecha del Vibe Coding

Cuando alguien sin conocimientos técnicos hace vibe coding de una aplicación, está tomando cientos de decisiones técnicas implícitas sin saberlo. Cada vez que la IA elige un framework, escribe un flujo de autenticación, estructura una base de datos o gestiona la entrada del usuario, está tomando decisiones que la persona que da las instrucciones no puede evaluar.

No es culpa de la IA. Hace lo que puede con lo que tiene. Pero quien está al otro lado no tiene el contexto para hacer las preguntas correctas:

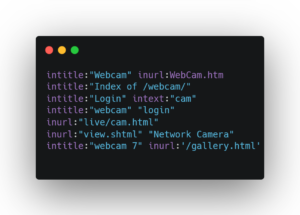

- ¿La autenticación es segura de verdad? Probablemente no. A la IA le encanta meter la autenticación en el lado del cliente.

- ¿Las claves API están hardcodeadas en el frontend? Más de lo que te imaginas.

- ¿La base de datos tiene controles de acceso? Casi nunca en código generado por IA.

- ¿Se sanitiza la entrada del usuario? Según el día.

- ¿Qué pasa cuando 10.000 usuarios se conectan a la vez? Nadie lo preguntó.

El resultado es software que funciona pero que no está diseñado con criterio profesional. Se ejecuta, tiene buena pinta, y es una bomba de relojería en producción. Ya lo vimos con el caso Enrichlead: un producto hecho íntegramente con vibe coding que fue reventado en 72 horas porque toda la lógica de seguridad vivía en el navegador.

Professional Vibe Coding: El Enfoque del Desarrollador

El Professional Vibe Coding no va de rechazar la IA. Va de usarla como acelerador sin soltar el volante en las decisiones que importan.

La distinción se reduce a esto:

| Vibe Coding | Professional Vibe Coding | |

|---|---|---|

| Quién | No-programadores, citizen developers | Desarrolladores profesionales, arquitectos |

| Prompt | «Hazme un panel de RRHH» | «Construye un panel de RRHH usando Next.js 15, Prisma ORM y NextAuth con OAuth2. Usa renderizado del lado del servidor para la lista de empleados…» |

| Arquitectura | Lo que la IA decida | El desarrollador diseña la arquitectura primero |

| Seguridad | Cruzar los dedos | El desarrollador especifica requisitos de seguridad |

| Revisión de código | Ninguna (o imposible) | El desarrollador revisa las rutas críticas |

| Stack tecnológico | Las elecciones por defecto de la IA | El desarrollador selecciona y acota el stack |

| Testing | «En mi máquina funciona» | Tests automatizados, CI/CD, entornos de staging |

| PRD/Requisitos | Descripción vaga | Documento de requisitos estructurado |

| Despliegue | «¡Ya está en producción!» | Infraestructura adecuada, monitorización, rollback |

El valor de un desarrollador profesional nunca fue solo escribir código. Siempre fueron las decisiones alrededor del código: qué construir, cómo estructurarlo, qué compromisos aceptar, qué riesgos mitigar. La IA se encarga de teclear. Los desarrolladores se encargan de pensar.

1. Diseño y Arquitectura

Un desarrollador profesional que usa vibe coding empieza antes del primer prompt. Diseña el sistema: arquitectura de componentes (qué módulos existen, cómo se comunican), modelo de datos (esquema de base de datos, relaciones, restricciones), contratos de API (endpoints, formatos de petición/respuesta, versionado), estrategia de gestión de errores y consideraciones de escalabilidad.

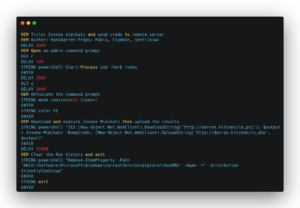

Después traduce ese diseño en prompts precisos y acotados. En lugar de «hazme un sistema de gestión de usuarios,» escribe:

«Crea un módulo de servicio de usuarios usando TypeScript. Usa Prisma con PostgreSQL. Implementa operaciones CRUD con borrado lógico. Usa bcrypt para el hash de contraseñas con un factor de coste de 12. Todos los endpoints requieren autenticación JWT mediante middleware. Validación de entrada con esquemas Zod. Devuelve respuestas de error estandarizadas siguiendo RFC 7807.»

La IA genera el mismo volumen de código en ambos casos. La calidad es radicalmente diferente porque el desarrollador tomó las decisiones importantes de antemano.

2. Selección del Stack Tecnológico

Uno de los riesgos más subestimados del vibe coding: dejar que la IA elija tu stack tecnológico. Los modelos están entrenados con datos a escala de internet, lo que significa que tienden hacia lo más popular, que no es necesariamente lo mejor para tu caso de uso.

Un desarrollador profesional selecciona el stack pensando en si el equipo puede mantenerlo, si escala a la carga esperada, el historial de seguridad del framework, la madurez del ecosistema y las implicaciones de licencia.

Después acota la IA para trabajar dentro de ese stack. Sin sorpresas. Sin paquetes npm aleatorios con 12 descargas. Sin bibliotecas obsoletas que la IA aprendió de datos de entrenamiento de 2022.

3. La Seguridad como Prioridad

Aquí es donde la brecha entre el vibe coding y el Professional Vibe Coding se hace más evidente.

El código generado por IA tiene un problema de seguridad bien documentado. Según el informe GenAI Code Security de Veracode de 2025, el 45% del código generado por IA contiene fallos de seguridad, sin mejora en los modelos más recientes. Las vulnerabilidades del OWASP Top 10 aparecen de forma rutinaria en aplicaciones hechas con vibe coding.

Un desarrollador profesional aborda esto especificando requisitos de seguridad directamente en el prompt («Usa consultas parametrizadas. Nunca concatenes la entrada del usuario en cadenas SQL.»), apoyándose en frameworks de seguridad consolidados (NextAuth, Passport.js, el sistema de auth de Django) en lugar de autenticación inventada por la IA, revisando las rutas de código críticas para la seguridad, ejecutando herramientas SAST como Semgrep o SonarQube en el pipeline de CI/CD, y haciendo pentesting antes del despliegue, no después de la brecha.

El no-programador que hace vibe coding de su app ni siquiera sabe que debería plantearse estas cuestiones. El desarrollador profesional las incorpora desde el primer día.

4. PRDs y Requisitos Estructurados

El Professional Vibe Coding trata el prompt como un documento de requisitos de producto (PRD). En lugar de descripciones en texto libre, los desarrolladores escriben especificaciones estructuradas:

## Funcionalidad: Registro de Usuarios

### Requisitos

- Registro con email/contraseña y verificación por email

- Login OAuth2 (Google, GitHub)

- La contraseña debe cumplir las directrices NIST 800-63B (mín. 8 caracteres, verificar contra lista de contraseñas comprometidas)

- Límite de tasa: 5 intentos de registro por IP por hora

- Almacenar contraseñas con Argon2id (memoria: 64MB, iteraciones: 3, paralelismo: 4)

### Criterios de Aceptación

- El usuario recibe el email de verificación en menos de 30 segundos

- Un email duplicado devuelve 409 Conflict (no un error genérico)

- Los registros fallidos se registran con IP y marca temporal

- Toda la PII cifrada en reposo (AES-256-GCM)Mete esto en una herramienta de codificación con IA y el resultado es radicalmente mejor que «añade registro de usuarios.» La IA tiene restricciones, expectativas y decisiones técnicas específicas que seguir. Es la diferencia entre entregar planos a un contratista o decirle «constrúyeme una casa.»

5. Revisión de Código (Cuando Tú Decides)

Los desarrolladores profesionales no tienen que revisar cada línea. Eso anularía el propósito de usar IA.

La estrategia es la revisión de código basada en riesgo:

- Revisar siempre: Autenticación, autorización, procesamiento de pagos, cifrado de datos, seguridad de APIs

- Revisar por muestreo: Lógica de negocio, transformaciones de datos, gestión de estado

- Confiar (con testing): Componentes de UI, estilos, boilerplate, configuración

Aplicas tu experiencia donde tiene mayor impacto. Una revisión de seguridad de 15 minutos del módulo de autenticación detecta más fallos reales que dedicar 3 horas revisando CSS autogenerado.

Por Qué el Vibe Coding Beneficia Más a los Desarrolladores que a los No-Programadores

Ya sé que suena al revés. Se supone que el vibe coding es el gran igualador, la herramienta que permite a los no-programadores crear software. Y lo es. Pero es más valioso para desarrolladores con experiencia, por tres razones.

Los Desarrolladores Saben Qué Pedir

La calidad del código generado por IA es directamente proporcional a la calidad del prompt. Un desarrollador que entiende de bases de datos, APIs, patrones de seguridad y diseño de sistemas escribe mejores prompts y obtiene mejor código como resultado.

Un no-programador dice: «Hazme una base de datos para mi app.»

Un desarrollador dice: «Crea un esquema PostgreSQL con claves primarias UUID, timestamps created_at/updated_at, columnas de borrado lógico y restricciones de clave foránea con ON DELETE CASCADE para la relación usuario-publicaciones. Añade un índice GIN en la columna JSONB posts.tags.»

La misma herramienta. Resultados radicalmente diferentes.

Los Desarrolladores Detectan los Errores que Importan

Cuando la IA genera un bug sutil (una condición de carrera, un off-by-one en la paginación, un índice que falta y que va a causar problemas de rendimiento a escala) el no-programador no tiene forma de detectarlo. El desarrollador sí.

Y lo más importante: el desarrollador sabe dónde mirar. No necesita revisar 5.000 líneas de código generado línea por línea. Sabe que el middleware de autenticación, la gestión de transacciones de base de datos y la validación de entrada son las rutas críticas donde la IA tiene más probabilidad de alucinar algo peligroso.

Los Desarrolladores Se Centran en Trabajo de Mayor Valor

Cuando la IA se encarga de la implementación, los desarrolladores quedan libres para centrarse en diseño de sistemas (cómo interactúan los componentes, cómo fluyen los datos), estrategia técnica (qué tecnologías adoptar, qué construir vs. comprar), arquitectura de seguridad (modelado de amenazas, reducción de la superficie de ataque, cumplimiento normativo), ingeniería de rendimiento y mentoría.

Estas son las actividades que crean más valor en cualquier organización de ingeniería. También son las que la IA no puede hacer bien, porque requieren criterio, contexto y conocimiento del dominio que ningún modelo posee.

Cómo Empezar con Professional Vibe Coding

Si eres desarrollador y aún no has dado el salto a la codificación asistida por IA, un punto de partida práctico:

Define antes de hacer el prompt. Dedica 15-30 minutos a diseñar la arquitectura, el modelo de datos y los contratos de API. Escríbelos. Esto se convierte en el contexto de tu prompt.

Acota el stack. Dile a la IA exactamente qué frameworks, bibliotecas y versiones usar. No la dejes improvisar.

Escribe los requisitos de seguridad de forma explícita. Si no mencionas la autenticación, la IA no la va a priorizar. Si no especificas consultas parametrizadas, la IA podría concatenar cadenas. Sin ambigüedades.

Revisa las rutas críticas. Autenticación, pagos, acceso a datos, cifrado. Todo lo demás puede revisarse por muestreo o validarse mediante testing.

Automatiza las puertas de calidad. Configura SAST, linting y tests automatizados en CI/CD. Que las máquinas detecten los problemas mecánicos para que tú te centres en los arquitectónicos.

Itera. El Professional Vibe Coding es iterativo. Genera, revisa, refina, regenera. Cada ciclo produce mejores resultados a medida que aprendes a comunicarte con la IA de forma más efectiva.

Conclusión

El vibe coding no va a desaparecer. Solo va a ser más rápido, más capaz y más accesible. Bien.

Pero la narrativa de que el vibe coding es «solo para no-programadores» no ve el panorama completo. Los desarrolladores profesionales son los que más se benefician porque tienen el conocimiento para guiar a la IA hacia buenas decisiones, detectar los errores que importan y centrar su energía en el trabajo de alto valor que la IA no puede hacer.

El futuro no es desarrolladores contra IA. Es desarrolladores con IA, trabajando a un nivel de abstracción superior. El código es la parte fácil. La arquitectura, la seguridad y el criterio profesional: ahí es donde los profesionales demuestran su valor.

Los no-programadores pueden vibrar. Los profesionales pueden vibrar con propósito.

Eso es Professional Vibe Coding.

- X (Twitter): @SimonRoses

Lecturas Recomendadas: